《Google官方SEO入门指å—》ä¹ï¼šæœ‰æ•ˆä½¿ç”¨robots.txt

一个robots.txt文件å¯ä»¥å‘Šè¯‰æœç´¢å¼•æ“Žä½ 网站的哪些部分å…许它去抓å–。而这个文件ä¸æ—¦å¿…须命åæˆâ€robots.txtâ€,è¿˜å¾—æ”¾åœ¨ä½ ç½‘ç«™çš„æ ¹ç›®å½•ä¸Šã€‚

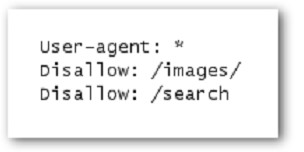

我们网站robots.txt文件的路径。

所有的éµå¾ªè¿™ä¸€è§„则的æœç´¢å¼•æ“Žçˆ¬è™«ï¼ˆæŒ‰ç…§é€šé…符*æŒ‡ç¤ºçš„é‚£æ ·ï¼‰ä¸åº”该进入并抓å–/images/或者任何以/search开头的url里的内容。

ä½ ä¹Ÿè®¸å¹¶ä¸å¸Œæœ›ä½ 网站的一些页é¢è¢«æŠ“å–åˆ°ï¼Œå› ä¸ºå¦‚æžœå®ƒä»¬å‡ºçŽ°åœ¨æœç´¢ç»“果里对用户å¯èƒ½æ˜¯æ²¡å¤šå¤§æ„ä¹‰çš„ã€‚å¦‚æžœä½ æƒ³é˜»æ¢æœç´¢å¼•æ“Žçˆ¬å–ä½ çš„ç½‘é¡µï¼ŒGoogle网站管ç†å‘˜å·¥å…·æœ‰ä¸€ä¸ªå¾ˆå¥½ç”¨çš„robots.txt生æˆå™¨æ¥å¸®åŠ©ä½ 创建这个文件。å¦å¤–å¦‚æžœä½ å¸Œæœ›å域å里的一些内容ä¸è¢«çˆ¬å–ï¼Œä½ éœ€è¦åœ¨å域å的目录下å†æ–°å»ºä¸€ä¸ªrobots.txtæ–‡ä»¶ã€‚ä½ ä¹Ÿå¯ä»¥åœ¨æˆ‘们的网站管ç†å‘˜å¸®åŠ©ä¸å¿ƒèŽ·å¾—更多关于robots.txtçš„ä¿¡æ¯ã€‚

这里也有其它更便æ·çš„æ–¹å¼æ¥é˜»æ¢ä½ 的内容出现在æœç´¢ç»“果里,比如说在robots metaæ ‡ç¾é‡Œæ·»åŠ â€NOINDEXâ€ï¼Œä½¿ç”¨htaccessæ¥ä¸ºä¸€äº›ç›®å½•åŠ 密或者使用Google网站管ç†å‘˜å·¥å…·æ¥ç§»é™¤æŸäº›å·²ç»è¢«ç´¢å¼•çš„内容。Google工程师 Matt Cutts一个帮助视频里粗略地介ç»äº†å„ç§URL排除原ç†çš„注æ„事项。

robots.txt实践ç»éªŒ

1ã€ä¸ºé‚£äº›æ•æ„Ÿçš„å†…å®¹ä½¿ç”¨æ›´åŠ å®‰å…¨çš„æ–¹æ¡ˆâ€”â€”é€šè¿‡robots.txtæ¥é˜»æ¢ä¸€äº›æ•æ„Ÿæˆ–è€…æœºå¯†çš„å†…å®¹ã€‚ä¹‹æ‰€ä»¥è¿™æ ·åšçš„æ˜¯å› ä¸ºå¦‚æžœé‚£äº›ä½ åœ¨robots.txt里阻æ¢çš„链接出现互è”网上(比如说æ¥æºè®°å½•ï¼‰ï¼Œæœç´¢å¼•æ“Žå°±å¾ˆå¯èƒ½å¼•ç”¨è¿™äº›URLs(ä¸è¿‡ä»…难是URL,ä¸ä¼šå«æœ‰æ ‡é¢˜æˆ–者内容片段)。还有一些ä¸éµå®ˆæœºå™¨äººæŽ’é™¤æ ‡å‡†çš„æµæ°“æœç´¢å¼•æ“Žåˆ™ä¼šè¿èƒŒrobots.txt上的指令。最åŽä¸€äº›å¥½å¥‡çš„ç”¨æˆ·å°±ä¼šåŽ»æŸ¥çœ‹ä½ robots.txt是声明阻æ¢çš„目录或者åç›®å½•ï¼Œå¹¶çŒœæµ‹é‚£äº›ä½ ä¸æƒ³è¢«çœ‹åˆ°çš„å†…å®¹ã€‚æ‰€ä»¥å¯¹å†…å®¹åŠ å¯†æˆ–è€…é€šè¿‡ .htaccess实现密ç ä¿æŠ¤ä¼šæ˜¯æ›´å®‰å…¨çš„é€‰æ‹©ã€‚å½“ç„¶ä½ éœ€è¦é¿å…:

·å…许看起æ¥åƒæœç´¢ç»“æžœä¸€æ ·çš„é¡µé¢è¢«çˆ¬å–。(用户并ä¸å–œæ¬¢æ‰”ç»™è‡ªå·±ä¸€å¼ æœç´¢é¡µé¢ï¼Œå…¨æ˜¯ä¸€äº›æ²¡æœ‰å¤šå¤§æ„义的结果。)

·å…许大é‡çš„自动生æˆçš„页é¢è¢«æŠ“å–,而里é¢å¤§å¤šéƒ½æ˜¯ç›¸åŒæˆ–者差异甚微的内容。“åƒè¿™äº›100000å¼ å‡ ä¹Žåƒå¤åˆ¶çš„页é¢è¢«æœç´¢å¼•æ“Žç´¢å¼•äº†æœ‰å¤šå¤§æ„义呢?â€

·å…许代ç†æœåŠ¡å™¨åˆ›å»ºçš„URLs被爬å–。

最后编辑: 郝聪 编辑于2008/11/26 18:38

我们网站robots.txt文件的路径。

所有的éµå¾ªè¿™ä¸€è§„则的æœç´¢å¼•æ“Žçˆ¬è™«ï¼ˆæŒ‰ç…§é€šé…符*æŒ‡ç¤ºçš„é‚£æ ·ï¼‰ä¸åº”该进入并抓å–/images/或者任何以/search开头的url里的内容。

ä½ ä¹Ÿè®¸å¹¶ä¸å¸Œæœ›ä½ 网站的一些页é¢è¢«æŠ“å–åˆ°ï¼Œå› ä¸ºå¦‚æžœå®ƒä»¬å‡ºçŽ°åœ¨æœç´¢ç»“果里对用户å¯èƒ½æ˜¯æ²¡å¤šå¤§æ„ä¹‰çš„ã€‚å¦‚æžœä½ æƒ³é˜»æ¢æœç´¢å¼•æ“Žçˆ¬å–ä½ çš„ç½‘é¡µï¼ŒGoogle网站管ç†å‘˜å·¥å…·æœ‰ä¸€ä¸ªå¾ˆå¥½ç”¨çš„robots.txt生æˆå™¨æ¥å¸®åŠ©ä½ 创建这个文件。å¦å¤–å¦‚æžœä½ å¸Œæœ›å域å里的一些内容ä¸è¢«çˆ¬å–ï¼Œä½ éœ€è¦åœ¨å域å的目录下å†æ–°å»ºä¸€ä¸ªrobots.txtæ–‡ä»¶ã€‚ä½ ä¹Ÿå¯ä»¥åœ¨æˆ‘们的网站管ç†å‘˜å¸®åŠ©ä¸å¿ƒèŽ·å¾—更多关于robots.txtçš„ä¿¡æ¯ã€‚

这里也有其它更便æ·çš„æ–¹å¼æ¥é˜»æ¢ä½ 的内容出现在æœç´¢ç»“果里,比如说在robots metaæ ‡ç¾é‡Œæ·»åŠ â€NOINDEXâ€ï¼Œä½¿ç”¨htaccessæ¥ä¸ºä¸€äº›ç›®å½•åŠ 密或者使用Google网站管ç†å‘˜å·¥å…·æ¥ç§»é™¤æŸäº›å·²ç»è¢«ç´¢å¼•çš„内容。Google工程师 Matt Cutts一个帮助视频里粗略地介ç»äº†å„ç§URL排除原ç†çš„注æ„事项。

robots.txt实践ç»éªŒ

1ã€ä¸ºé‚£äº›æ•æ„Ÿçš„å†…å®¹ä½¿ç”¨æ›´åŠ å®‰å…¨çš„æ–¹æ¡ˆâ€”â€”é€šè¿‡robots.txtæ¥é˜»æ¢ä¸€äº›æ•æ„Ÿæˆ–è€…æœºå¯†çš„å†…å®¹ã€‚ä¹‹æ‰€ä»¥è¿™æ ·åšçš„æ˜¯å› ä¸ºå¦‚æžœé‚£äº›ä½ åœ¨robots.txt里阻æ¢çš„链接出现互è”网上(比如说æ¥æºè®°å½•ï¼‰ï¼Œæœç´¢å¼•æ“Žå°±å¾ˆå¯èƒ½å¼•ç”¨è¿™äº›URLs(ä¸è¿‡ä»…难是URL,ä¸ä¼šå«æœ‰æ ‡é¢˜æˆ–者内容片段)。还有一些ä¸éµå®ˆæœºå™¨äººæŽ’é™¤æ ‡å‡†çš„æµæ°“æœç´¢å¼•æ“Žåˆ™ä¼šè¿èƒŒrobots.txt上的指令。最åŽä¸€äº›å¥½å¥‡çš„ç”¨æˆ·å°±ä¼šåŽ»æŸ¥çœ‹ä½ robots.txt是声明阻æ¢çš„目录或者åç›®å½•ï¼Œå¹¶çŒœæµ‹é‚£äº›ä½ ä¸æƒ³è¢«çœ‹åˆ°çš„å†…å®¹ã€‚æ‰€ä»¥å¯¹å†…å®¹åŠ å¯†æˆ–è€…é€šè¿‡ .htaccess实现密ç ä¿æŠ¤ä¼šæ˜¯æ›´å®‰å…¨çš„é€‰æ‹©ã€‚å½“ç„¶ä½ éœ€è¦é¿å…:

·å…许看起æ¥åƒæœç´¢ç»“æžœä¸€æ ·çš„é¡µé¢è¢«çˆ¬å–。(用户并ä¸å–œæ¬¢æ‰”ç»™è‡ªå·±ä¸€å¼ æœç´¢é¡µé¢ï¼Œå…¨æ˜¯ä¸€äº›æ²¡æœ‰å¤šå¤§æ„义的结果。)

·å…许大é‡çš„自动生æˆçš„页é¢è¢«æŠ“å–,而里é¢å¤§å¤šéƒ½æ˜¯ç›¸åŒæˆ–者差异甚微的内容。“åƒè¿™äº›100000å¼ å‡ ä¹Žåƒå¤åˆ¶çš„页é¢è¢«æœç´¢å¼•æ“Žç´¢å¼•äº†æœ‰å¤šå¤§æ„义呢?â€

·å…许代ç†æœåŠ¡å™¨åˆ›å»ºçš„URLs被爬å–。

相关日志

SEO项目分æžåŠè¿ä½œæµç¨‹

第五届Netconcepts SEO排行榜大会演讲PPT分享

百度æœç´¢ç»“æžœå›¾æ–‡æ ‡è¯†è§„åˆ™åˆ†æž

Flash网页SEO特殊优化ç–ç•¥

Wordpress SEOæ’件

æœæœSoSoæœç´¢å¼•æ“Žä¼˜åŒ–SEO规范

ã€SEO必备】百度蜘蛛IP段大全与æƒé‡è¯´æ˜Ž

社会化è´ç‰©åˆ†äº«ç½‘ç«™SEOç–ç•¥ç ”ç©¶

百度站长平å°â€œå¤–链工具â€ä¸Žâ€œæœç´¢å…³é”®è¯æŸ¥è¯¢â€åŠŸèƒ½è¯„测

从Bing(必应)SEO技巧ä¸åˆ†æžæœªæ¥ç½‘站优化的å‘展趋势

SEO项目分æžåŠè¿ä½œæµç¨‹

第五届Netconcepts SEO排行榜大会演讲PPT分享

百度æœç´¢ç»“æžœå›¾æ–‡æ ‡è¯†è§„åˆ™åˆ†æž

Flash网页SEO特殊优化ç–ç•¥

Wordpress SEOæ’件

æœæœSoSoæœç´¢å¼•æ“Žä¼˜åŒ–SEO规范

ã€SEO必备】百度蜘蛛IP段大全与æƒé‡è¯´æ˜Ž

社会化è´ç‰©åˆ†äº«ç½‘ç«™SEOç–ç•¥ç ”ç©¶

百度站长平å°â€œå¤–链工具â€ä¸Žâ€œæœç´¢å…³é”®è¯æŸ¥è¯¢â€åŠŸèƒ½è¯„测

从Bing(必应)SEO技巧ä¸åˆ†æžæœªæ¥ç½‘站优化的å‘展趋势

最后编辑: 郝聪 编辑于2008/11/26 18:38

稻壳å‘电

2009/08/15 19:22

robots.txt是值得å¦ä¹

gamc001

2008/11/27 15:15

éžå¸¸æœ‰ç”¨ï¼Œè°¢è°¢

sunshineg

2008/11/27 12:04

å¦ä¹ 了.........

分页: 1/1  1

1

1

1

《Google官方SEO入门

《Google官方SEO入门 《Google官方SEO入门

《Google官方SEO入门